Дилемма смещения-дисперсии

Материал из Википедии — свободной encyclopedia

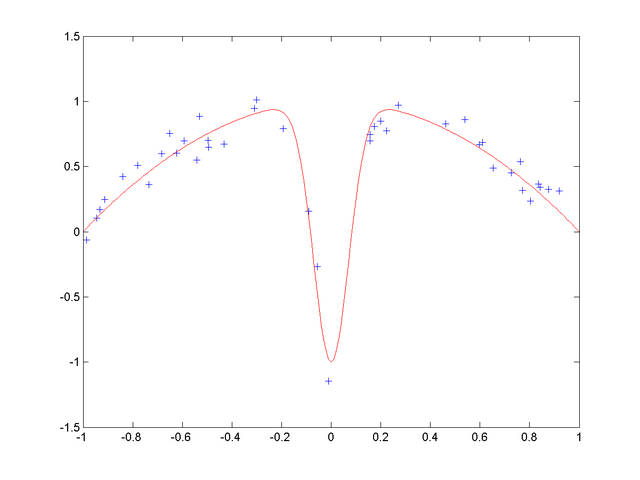

Компромисс отклонение-дисперсия в статистике и в машинном обучении — это свойство набора моделей предсказания, когда модели с меньшим отклонением от имеющихся данных имеют более высокую дисперсию на новых данных (то есть подвержены переобучению), и наоборот. Компромисс отклонение-дисперсия — конфликт при попытке одновременно минимизировать эти два источника ошибки[англ.], которые мешают алгоритмам обучения с учителем делать обобщение за пределами тренировочного набора.

- Смещение — это погрешность оценки, возникающая в результате ошибочного предположения в алгоритме обучения. В результате большого смещения алгоритм может пропустить связь между признаками и выводом (недообучение).

- Дисперсия — это ошибка чувствительности к малым отклонениям в тренировочном наборе. При высокой дисперсии алгоритм может как-то трактовать случайный шум[англ.] в тренировочном наборе, а не желаемый результат (переобучение).

Разложение смещения-дисперсии — это способ анализа ожидаемой ошибки обобщения[англ.] алгоритма обучения для частной задачи сведением к сумме трёх членов — смещения, дисперсии и величины, называемой неустранимой погрешностью, которая является результатом шума в самой задаче.

Дилемма возникает во всех формах обучения с учителем — в классификации, регрессии (аппроксимация функции)[1][2] и в структурном прогнозировании. Дилемма также используется для объяснения эффективности эвристики при обучении людей[3].