Компроміс зсуву та дисперсії

З Вікіпедії, безкоштовно encyclopedia

У статистиці та машинному навчанні, компромі́с (або диле́ма) зсу́ву та диспе́рсії (англ. bias–variance tradeoff or dilemma) — це задача одночасної мінімізації двох джерел похибки, які перешкоджають алгоритмам керованого навчання робити узагальнення на основі їхніх тренувальних наборів:

- Зсув (англ. bias) — це похибка, викликана помилковими припущеннями в алгоритмі навчання. Великий зсув може спричиняти нездатність алгоритму знаходити доречні взаємозв'язки між ознаками та цільовими виходами (недонавчання).

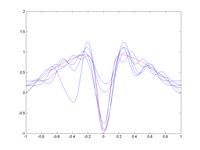

- Дисперсія (англ. variance) — це похибка від чутливості до малих флуктуацій в тренувальному наборі. Висока дисперсія може спричиняти перенавчання: моделювання випадкового шуму[en] в тренувальних даних замість моделювання бажаних виходів.

Ро́зклад на зсув та диспе́рсію (англ. bias–variance decomposition) — це спосіб аналізувати очікувану похибку узагальнення алгоритму навчання по відношенню до тієї чи іншої задачі як суму трьох членів: зсуву, дисперсії, та величини, що називається незнижуваною похибкою (англ. irreducible error), яка виникає внаслідок шуму в самій задачі.

Цей компроміс застосовується до всіх видів керованого навчання: класифікації, регресії (узгодження функцій)[1][2] та навчання структурованого виходу. Його також залучали для пояснення дієвості евристик у людському навчанні.