トップQs

タイムライン

チャット

視点

チューリング・テスト

ウィキペディアから

Remove ads

チューリング・テスト(英: Turing test)は、アラン・チューリングが提案した、ある機械が「人間的」かどうかを判定するためのテストである。これが「知的であるかかどうか」とか「人工知能であるかどうか」とかのテストであるかどうかは、「知的」あるいは「(人工)知能」の定義、あるいは、人間が知的であるか、人間の能力は知能であるか、といった定義に依存する。

概要

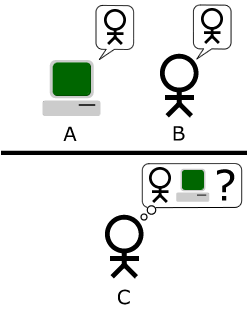

アラン・チューリングが1950年に『Computing Machinery and Intelligence』の中で書いたもので、以下のように行われる。人間の判定者が、一人の(別の)人間と一機の機械に対して通常の言語での会話を行う。このとき人間も機械も人間らしく見えるように対応するのである。これらの参加者はそれぞれ隔離されている。判定者は、機械の言葉を音声に変換する能力に左右されることなく、その知性を判定するために、会話はたとえばキーボードとディスプレイのみといった、文字のみでの交信に制限しておく[注釈 1]。判定者が、機械と人間との確実な区別ができなかった場合、この機械はテストに合格したことになる。

このテストについては、もっともだと納得する人もいれば、そうでない人もいた。後に実際に人間と「会話」するコンピュータ・プログラムが現れた後における知見としては、「ELIZA効果」などのように、先入観や情況などによって単純な(「機械的」な)反応をするだけのものにも人間はだまされてしまう場合があるということがわかり、それは結果的にはこのテストの発想への反例と考えられることがある。サールは、そのような一見人工知能のように見えるものを"弱いAI"とした。他にもサールは「中国語の部屋」という、表面的にはこのテストと同じであるにもかかわらず、直観的にはその示す所に納得できないようなアレンジを提示している。

2014年6月7日、ロンドンのテストに「13歳の少年」の設定で参加したロシアのチャットボットであるユージーン・グーツマンが、30%以上の確率で審査員らに人間と間違われて史上初めての「合格者」となった[1][2][注釈 2]。

2025年3月31日、カリフォルニア大学の研究チームがOpenAIのLLM GPT-4.5が73%という高い割合で人間として判定されチューリングテストを合格したと報告。[3][4]

Remove ads

歴史

要約

視点

哲学上の背景

1956年に生まれた人工知能の分野[5] は、哲学的にかなり根が深い問題であった。機械は思考できるのかという問題には長い歴史の末に、心に関する二元論と唯物論にはっきりと分けられていた。二元論の立場からすれば、心は形而上の(もしくは少なくとも形而上の性質を持っている[注釈 3])存在であり、したがって単に物理的な文脈では説明できないことになる。一方、唯物論の立場からすれば、心は物理的に説明できることから、心を人工的に作りだせる可能性はあることになる[注釈 4]。

1936年、哲学者のアルフレッド・エイヤーは、他者の心に関して、「他者が自分と同様の意識体験を持っているとなぜ分かるのか」という有名な哲学的疑問を検討した。エイヤーは、『言語・真理・論理』の中で、意識を持つ人間と意識を持たない機械を区別する方法を以下のように提案している。「私にとって、意識を持っているように見える対象が、本当は意識をもつ存在ではなく、単なるダミーや機械であると判断する根拠は、意識の有無を判定するための経験的なテスト(empirical tests)のどれかに失格した、ということしかない[6] 」この意見は、チューリング・テストにとてもよく似ているが、チューリングがエイヤーによるこの哲学上の古典の内容を知っていたかどうかは定かでない。

チューリング

イギリスの研究者たちは、AI研究という分野が確立する1956年より10年ほど前から「機械の知性」を研究していた。これはレイショウ・クラブのメンバーの共通のトピックであった。レイショウ・クラブは、イギリスのサイバネティクス・電子工学研究者による非公式の研究者グループであり、チューリングテストの名前の由来であるアラン・チューリングもメンバーの一人だった[7]。

特にチューリングは、少なくとも1941年から機械の知性の概念に取り組んでおり[8]、1947年に「コンピュータの知性(computer intelligence)」について触れているのは、知られている限りで最も早い[9]。論文『知性を持つ機械(Intelligent Machinery)』の中で、チューリングは「機械に知性を持ったふるまいができるかどうかという問題[10]」 について検討しており、この中で後に発表するチューリングテストの先駆けとも思われる提案をしている。

チェスでなかなかいい試合をする紙上のマシーンを作るのは難しくない[注釈 5]。さて、実験の被験者としてA、B、Cの三人を用意しよう。AとCはチェスがあまり上手くない。Bはマシーンのオペレーターである。……手を伝えるための仕掛けを施した二つの部屋を使う。そしてC対AもしくはC対マシーンでゲームを行う。Cは自分の相手がどちらなのか、なかなか分からないかもしれない。

このように、チューリングは論文『計算する機械と知性(Machinery and Intelligence)』を発表する以前から、数年間人工知能の可能性を検討していたのである。とはいえ、発表された論文[注釈 6] で、この概念のみに焦点を当てたのは、『計算する機械と知性』が最初である。

チューリングは、1950年の論文『計算する機械と知性』を「私は、『機械は思考できるか』という問題の検討を提案する」という主張で始めている[11]。チューリングが強調しているように、このような問題への伝統的なアプローチは、「機械」と「知性」の定義から入ることである。だが、チューリングはあえてそうせず、代わりに問題を「緊密に関係しており、比較的厳密な言葉で表現されている」新しい問題に転換した[11]。つまり、チューリングの提案は、「機械は思考できるか」という問題を「機械は我々が(考える存在として)できることをできるか[12] 」に換えることであった。チューリングの主張するこの新しい問題の利点は「人間の、物理的な能力(capacity)と知的な能力の間の、公平で厳しい境界線」を引く、ということであった。

この方法を説明するために、チューリングは、「模倣ゲーム(The Imitation Game)」というテストを提案している。模倣ゲームとは、本来、男性と女性が別々の部屋に入り、ゲストはいくつかの質問を書き、それに対するタイプ打ちの回答を読んで、どちらが男性でどちらが女性か当てるというゲームである。このゲーム中の男性は、ゲストに女性と思わせるのが目的となる。チューリングは、以下のように作り直した模倣ゲームを提案している。

ここで問題だが、「このゲームにおけるAの役を、機械がやったらどうなるだろうか」質問者は、男性と女性でゲームを行ったときと同じくらいの頻度で、間違った判断をするだろうか。この問題が、元々の「機械は思考できるか」という問題を代替するのである[13]。

論文の後部で、チューリングは、二者間で行う「同じ」図式を提案しており、ここでは質問者はコンピュータか人間の、どちらかとだけ会話する[14]。このどちらの図式も、現在一般に知られているチューリングテストと正確には一致しない。チューリングは1952年に3つめの図式を提唱している。この、チューリングがBBCのラジオ放送で語ったバージョンでは、審査員はコンピューターにいくつか質問をする。コンピューターの役割は、審査員たちの多くを本物の人(man)[注釈 7]と信じ込ませることである[15]。

チューリングの論文では、9つの反論が想定されており、論文が初めて発表されてから出された、人工知能に関する主要な議論がこの中にすべて含まれている[16][注釈 8]。

ELIZAとPARRY

ブレイ・ウィットビー(Blay Whitby)は、チューリングテストに関する歴史の中に、以下の4つの大きなターニングポイントを挙げている。

- 1950年の『計算機械と知性』の出版

- 1966年のジョセフ・ワイゼンバウムによるELIZAの発表

- 1972年のケネス・コルビーのPARRY製作

- 1990年のチューリング会議[17]

ELIZAは、ユーザーが打ったコメントからキーワードを探し出して動作する。キーワードが見つかれば、ユーザーのコメントを変換するルールが適用され、その結果の文章が返される。キーワードが見つからなければ、ELIZAは一般的な返事をするか、もしくは前に行った言葉を繰り返す[18]。さらに、ワイゼンバウムは来談者中心療法のセラピストのふるまいを真似るようにELIZAを作った。つまりELIZAを「実世界のことをほとんど何も知らないかのようにふるまえる」ようにしたのである[19]。これらのテクニックにより、ワイゼンバウムのプログラムはいくらかの人を騙し、実際の人間としゃべっていると思わせることができたのである。「ELIZAが人間『じゃない』なんて……とても納得できない」という被験者もいた[19]。このように、ELIZAはチューリングテストを通過できるプログラムの(おそらく最初の)一つであることが多くの人によって主張された。

コルビーのPARRYは「感情傾向(attitude)のあるELIZA」と呼ばれた[20]。PARRYはワイゼンバウムと(高度ではあるかもしれないが)同様の手法を使って偏執性統合失調症のふるまいを再現するよう試みたものである。研究を実証するため、PARRYは1970年代初期にチューリングテストのバリエーション試験を受けた。まずテレタイプ端末を通して、経験豊富な精神科医に、本物の患者とPARRYが動作するコンピュータの精神分析をさせた。次に別の精神科医のグループ33人に、この会話記録を見せる。そして、この二つのグループにどちらの「患者」が人間でどちらがプログラムか判別させた[21]。この実験では、正しく判別できた精神科医は48パーセントだった。当てずっぽうで決めたのと同様の数字である[22]。

ELIZAもPARRYも、厳密なチューリングテストを通過できたというわけではないが、ELIZA・PARRY、そして同様のソフトウェアは、チューリングテストを通過できるようなソフトウェアが作られる可能性を示唆している。さらに重要なのは、そのチューリングテストを通過できるソフトウェアに含まれるのは、データベースと単純なルールの適用だけ、ということもありうることだ。

中国語の部屋

→詳細は「中国語の部屋」を参照

ジョン・サールは、1980年の論文『心・脳・プログラム(Minds, Brains, and Programs)』の中でチューリングテストに対する反論を提出した。これは「中国語の部屋」として知られる思考実験である。サールは、単に理解していない記号を処理しているだけでも(ELIZAのような)ソフトはチューリングテストに合格できると述べた。理解していないのならば、人間がやっているのと同じ意味で「思考」しているとはいえないということだ。したがって、チューリングのもともとの提案とは逆に、チューリングテストは機械が思考できるということを証明するものではないとサールは結論している[23]。

サールその他の心の哲学の研究者が提出した議論は、知性の本質、知性を持った機械の可能性、チューリングテストの価値についての、1980年代・1990年代を通しての激しい議論の火種となった[24]。

チューリング会議

1990年は、チューリングの『計算機械と知性』が最初に発表されてから40周年であったため、チューリングテストが再注目された。この年、2つの重要なイベントが起こった。1つ目は、4月にサセックス大学で開かれたチューリング会議(Turing Colloquium)である。このとき様々な分野の学者・研究者が集まってチューリングテストの過去・現在・未来について話し合った。2つ目は、毎年1回のローブナー賞大会の設立である。

ローブナー賞

→詳細は「ローブナー賞」を参照

ローブナー賞では、チューリングテストを実際に行う場を毎年提供している。最初の大会は、1991年の11月に開かれた。ローブナー賞はヒュー・ローブナーによって開催され、アメリカマサチューセッツ州のケンブリッジ行動研究センター(the Cambridge Center for Behavioral Studies)が2003年まで運営していた。ローブナーが語ったように、大会の目的はAI研究を発展させることであり、また「それ(チューリングテスト)を実際にやろうとする人が誰もいなかった」ことも開催理由の一部である[25]。

銀賞(聴覚)と金賞(聴覚・視覚)の受賞はまだない。だが、エントリーした中で、審判の意見による、「最も人間らしい(most human)」会話上のふるまいを見せたコンピュータシステムに毎年銅賞が贈られている。Artificial Linguistic Internet Computer Entity(A.L.I.C.E. 人工言語インターネットコンピュータ体)は近年3回(2000、2001、2004)銅賞を受賞している。学習型AIのJabberwackyは2005年と2006年に受賞している。Jabberwackyの制作者たちは、テストの通過のため、テストの前に人間のプレイヤーと長く会話しておき、テストの際はこのプレイヤーの真似に専念する、という個人化バリエーションの機能を導入した[26]。

ローブナー賞で試験されるのは会話上の知性である。受賞プログラムは典型的な会話ボットであり、人工話者である。初期のローブナー賞では会話の制限がルールとなっていた。エントリーされたプログラムや隠れた人間が話すのは一つの話題のみで、同様に、質問者も一回につき一行のみに制限された質問を行っていた。この会話制限のルールは1995年のローブナー賞では取り払われ、様々な長さの会話がなされるようになった。サリー大学で行われた2003年のローブナー賞では、質問者はプログラムもしくは人間の相手と5分間話すことができた。2004年から2007年は、20分以上会話に時間をとってもよいことになった。2008年には質問の制限時間は1組あたり5分になった。これは主催者のケビン・ウォーリック(Kevin Warwick [27])とまとめ役のヒューマ・シャー(Huma Shah [28])が、長い会話をしたからといって、人工話者がほんとうに進歩したとはいえないと考えたためであった。皮肉にも、2008年の受賞プログラムのエルボットは人間を真似るものではなかった。個性はロボット自身のものだったにもかかわらず、人間と並行比較して、3人の質問者を騙し、人間だと思わせた。

ローブナー賞により、チューリングテストの現実性や、テストを実行する意義について新たに議論が巻き起こった。『エコノミスト』誌は、「artificial stupidity(人工馬鹿)」というタイトルの記事中で、最初のローブナー賞受賞プログラムの受賞理由(少なくとも理由の一部)が、「人間らしいタイプミスを真似」できたからだと書いている[29](チューリングは、出力にミスを加えれば、プログラムはゲームのより良い「プレイヤー」になると勧めている[30])。チューリングテストの通過に挑戦するのは他の実のある研究の邪魔になるだけだと言うものもいる[31]。ローブナー賞の初期に第二の問題が起こった。「単純な(unsophisticated)」質問者を使ったため、知性と思われる何らかの要素よりも、器用に作られたごまかしが通過できたということである[32]。ローブナー賞は2004年から質問者の中に哲学者・計算機科学者・ジャーナリストを配している。

2005年 会話システム会議

2005年11月、サリー大学の主催で人工話者の開発者たちの1日集会が初めて開催され、ロビー・ガーナー、リチャード・ウォレス、ロロ・カーペンターらの、ローブナー賞受賞者も出席した。招聘された講演者は、デビッド・ハミル、ヒュー・ローブナー、ヒューマ・シャー[28] など。

AISB2008 チューリングテストについてのシンポジウム

2008年、レディング大学で開かれたローブナー賞と並行して、AISB(Artificial Intelligence and Simulation of Behaviour人工知能および行動シミュレーション)研究会が、チューリングテストについて話し合う1日シンポジウムを開いた。主催はジョン・バーンデン、マーク・ビショップ、ヒューマ・シャー、ケビン・ウォーリック。講演者はイギリス王立研究所理事のスーザン・グリーンフィールド(Baroness Susan Greenfield)、Selmer Bringsjord、チューリングの伝記作家アンドリュー・ホッジズ[33]、認識科学者オーウェン・ホラント[34] などである。正式なチューリングテストに関する合意は得られなかったが、Bringsjordは相当に大きな賞を設ければ、チューリングテストの通過は早くなるだろうと語った。

Remove ads

チューリングテストの別バージョン

要約

視点

チューリングテストの初期バージョンには主に少なくとも3つがある。この内2つは『計算機械と知性』で述べられたもので、最後の1つはソール・トライガー(Saul Traiger)が「標準解釈」と述べた[35] バージョンである。この「標準解釈」が、チューリングが述べた通りのものなのか、チューリングの論文のミスリードに基づくものなのかには議論があるが、これらの3つのバージョンは同値であると見なされておらず[35]、それぞれ長所と短所がはっきりしている。

模倣ゲーム

先述したように、チューリングは3人のプレイヤーからなるただのパーティーゲームについて書いている。プレイヤーAは男性、プレイヤーBは女性、プレイヤーC(質問者)の性別はどちらでもよい。模倣ゲームの中で、プレイヤーCはプレイヤーA・Bのどちらも見ることができず、文字の書かれたメモを通してしかコミュニケーションできない。プレイヤーAとBにいくつか質問することで、プレイヤーCはどちらが男性でどちらが女性かの判断を試みる。プレイヤーAの役は、質問者を騙して間違わせるのが役目で、一方プレイヤーBは質問者を手助けして正しく答えさせるのが役目である[36]。

チューリングはコンピュータがプレイヤーAの役をするのはどうかと提案した。これがスーザン・G・スターレットが「原型模倣ゲームテスト(Original Imitation Game Test)」[37] と呼ぶテストである。したがってコンピュータの役目は、女性になりきって質問者を騙し、間違った答えを出させることである。コンピュータが成功したかどうかは、プレイヤーAがコンピュータの場合の結果とプレイヤーAが男性だった場合を比較して判断する。チューリングが述べたところでは、もし「男性と女性でゲームを行ったときと同じくらいの頻度で、(対コンピュータのゲームで)間違った判断をする」[13] ならば、そのコンピュータには知性があると言える可能性がある。

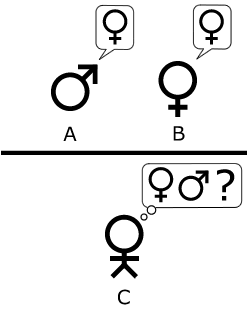

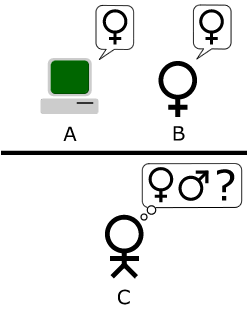

チューリングの1950年の論文で第二のバージョンが発表された。原型模倣ゲームテストと同様に、プレイヤーAの役はコンピュータが演じるが、プレイヤーBの役が女性ではなくman(男性、人間)になっている点が異なる。

「特別なデジタルコンピュータCに注目しよう。このコンピュータに十分な記憶容量を持たせて、実行速度を相当に強化し、適切なプログラムを入れたとする。man(男性、人間)がBの役をやっている中、Cは模倣ゲームにおけるAの役を十分にこなすことができるだろうか?

このバージョンでは、プレイヤーA(コンピュータ)とプレイヤーBはどちらも質問者を騙して間違った答えを出させようとしている。[38]

標準解釈

チューリングテストは単に「コンピュータは質問者を騙してコンピュータを女性と思いこませるられるか」を確かめるのが目的ではなく、「コンピュータは人間の真似をできるか」を確かめるのが目的である、という共通見解があり[38]、――この見解がチューリングの意図通りのものなのかという議論もあるが、スターレットはこの見解を信じており[37]、これに合わせて第1・第2のバージョンをまとめている。トライガーなど、この見解を否定しているものもいる[35]――この共通見解から「標準解釈」とされる解釈が導き出された。この標準解釈のバージョンでは、プレイヤーAはコンピューターでプレイヤーBは人間(性別はどちらでもよい)である。質問者の役目は、どちらが男性でどちらが女性であるかを当てることでなく、どちらがコンピュータでどちらが人間かを当てるものである[39]。

模倣ゲームvs標準チューリングテスト

どの解釈がチューリングの意図したものなのかについては議論があった[37]。スターレットは、チューリングの1950年の論文にある二つのテストは、チューリング自身の発言とは逆に、同値ではないとしている。パーティーゲームを用いて正解頻度を比べるテストは「原型模倣ゲームテスト(Original Imitation Game Test)」と呼ばれ、一方で人間および機械と会話して、人間が(会話相手が機械かどうか)裁定するテストは「標準チューリングテスト(Standard Turing Test)」と呼ばれる。スターレットは、これを模倣ゲームの第二バージョンではなく「標準解釈(standard interpretation)」であると述べている。標準チューリングテストには、批判者も指摘する問題がいくつかあるが、定義上の原型模倣ゲームテストは標準チューリングテストと決定的な違いがあるため、それらの問題の多くに免疫があるという。原型模倣ゲームテストは判断基準を設定するために人間のふるまいを使用するけれども、人間のふるまいを真似できるかは判断基準にしていないのである。人間(男)が原型模倣ゲームテストに落ちることもありうるが、落ちることによって臨機応変の才に欠けた人が分かる、ということは知性のテストとして望ましいというのがスターレットの主張である。つまり原型模倣ゲームテストでは「会話の振る舞いのシミュレーション」ではなく、知性が伴う臨機応変の才が必要になる、ということだ。この原型模倣ゲームテストの基本構造は、非言語の模倣ゲームにも使える[40]。

他の著作家[41] もチューリングは模倣ゲーム自体をテストであると主張していたと解釈しているが、パーティーゲームとしての模倣ゲームを使ってチューリングが提案したテスト(スターレットの言う原型模倣ゲームテスト)に関して、ゲーム1ラウンドあたりの成功数ではなく、(パーティーゲームとしての)模倣ゲームとの成功頻度の比較を判断基準に据える、というチューリングの言説をどう考えるかは特定できていない。

質問者はコンピュータのことを知っているべきか?

参加者のひとりがコンピュータだとテストの質問者は知っているのかどうか、チューリングは明言しなかった。原型模倣ゲームテストに関しては、チューリングはプレイヤーAが機械と入れ替わると言っただけで、プレイヤーCにこの交代が知らされるとは書いていない[13]。F・D・ヒルフ、S・ウェーバー、A・D・KramerがPARRYをテストした時は、機械の存在を知らせていた。質問者はインタビュー対象のひとりかそれ以上機械がいるのか知るまでもないとしている[42]。しかし、Ayse Sayginなどが強調しているように、この問題はチューリングテストの実装および結果に大きな違いを産む。

Remove ads

テストの強み

話題の広さ

チューリングテストの強みの理由は、何について話してもよいという点である。チューリングは「我々が努力しようと思うようなどんな分野だろうと、その導入にはQ&A方式が適切であるように思える」と記している[43]。John Haugelandは「言葉を理解する、というのは不十分だ。話題を理解しなくてはならない」と補足している[44]。

うまくデザインされたチューリングテストを通過するには、機械は自然言語、常識的推論、知識、学習を活用しなければならない。またチューリングテストを映像入力や対象を取り入れる「入り口」を含めた形に拡張することもできる。こうなると機械は映像やロボット工学の技術も導入しなければならなくなる。これらによって、人工知能の主な問題はほぼ全て出そろう[45] のである。

テストの弱み

要約

視点

これらの強みや評価にもかかわらず、チューリングテストはいくつかの立場から批判されている。

人間の知性vs一般的な知性

→「強いAIと弱いAI」を参照

チューリングテストは、「知性」や「知覚力」があるかをテストするものではなく、コンピューターが人間を真似ることができるかをテストするもので、明らかに擬人的である。チューリングテストが一般的に言う知性(intelligence)を試験できない理由は二つある。

- 人間の行動には知性によらないものがあるが、チューリングテストでは、機械は知性によるものであろうとなかろうと、全ての人間の行動をこなす必要がある。チューリングテストでは、全く知性に欠けたふるまいと思える行動さえも試される。例えば侮辱に対して反応したり、嘘をつきたいと考えたり、もしくは単純に高頻度でタイプミスをしたり、などである。タイプミスなど諸々の人間の行動の細かい真似ができない機械は、どんなに知性があろうとテストは不合格になる。

- 知性による行動の中には、非人間的なものもある。難しい問題を解いたり、独自の洞察を思いついたりといった、すぐれて理知的な行動は、チューリングテストでは試されない。機械のほうからすれば、ごまかしが事実上必要になる。もしも人間には解けないような計算問題を素早く解いてしまうと、定義によりテストには不合格になる。

非実用性

スチュアート・J・ラッセルとピーター・ノーヴィグは、チューリングテストは、その擬人観のせいで知性を持つ機械の工学上の課題としてあまり実用的ではなくなってしまっていると主張した。ラッセルらは例えを用いて、「航空力学のテキストは、その部門における目標を『他の鳩を騙せるくらいに、鳩と全く同じように飛ぶ機械を作ること』と定義したりしない」と説明している[46]。この非実用性のために、最も普遍的な解釈のチューリングテストへの挑戦は、2005年の時点では学術的・商業的な取り組みの主流からはあまり目を向けられていない。人工知能関係の分野での研究は、現在もっと小規模かつ特定された目標に注目している。

ラッセルとノーヴィグは、プログラムをテストする方法はもっと簡単なものがあるため、「人工知能の研究家は、チューリングテストの合格にほとんど注意を払っていない」と書いている[46]。例えば、人と機械を入れたチャットルームでまず質問するというような遠回しな方法よりも、直接命令を与えたほうが簡単なのだ。チューリングは、自らが考えたテストがAIプログラムにおける実際の日常的な指標として用いられるとはまったく意図していなかった。チューリングは、人工知能の哲学を語る際の助けとなる、明確で理解しやすい例を提示しようとしたのである[注釈 9]。

現実の知性vsシミュレート上の知性

チューリングテストはまた、対象のふるまいのみを試すという点で明らかに行動主義・機能主義である。チューリングテストに合格する機械が人間の会話上の振る舞いをシミュレートできるのは、ただ巧妙に作られたルールに沿っているだけだから、ということもありうる。この文脈における有名な反論は、ジョン・サールの中国語の部屋と、ネド・ブロックのブロックヘッドの二つがある。

知性の作業定義としてチューリングテストが有効であったとしても、チューリングテストによって機械に意識(consciousness)や自主性(intentionality)があるかを測れるとは限らない。たとえば知性と意識がそれぞれ別個の概念だったとしたら、チューリングテストは知性のある機械と知性のある人間との間にある、鍵となる相違を見いだせないということもありうる。

Remove ads

バリエーション

先述したものも含め、チューリングテストには数多くの別バージョンが議論されてきた。

反転チューリングテストとCAPTCHA

対象者や、それぞれの役目における機械・人間を反転させたチューリングテストは、反転チューリングテストと呼ばれる。これには精神分析学者のウィルフレッド・バイオンの著作[47] で触れられた例がある。バイオンは特に、心と別の心の出会いが生む「嵐(storm)」に注目していた。ロバート・D・ヒンシェルウッド(R. D. Hinshelwood)はこの考えを進めて、心は「装置(apparatus)を認識する心」であるとし、このことがチューリングテストのある種の「補足」になりうると述べている。この場合の課題は、「関わっている相手が人間か別のコンピュータなのか、コンピュータ自身が判断できるか」になる。これはチューリングが試みた問題の拡張であり、人間らしく見えるように「考える」機械を見つけ出すためには、より高い水準の機械が必要となるであろう。

CAPTCHAは反転チューリングテストの一種である。ウェブサイト上で何らかの行動をする許可を得る前に、ユーザーはねじれた画像上の文字列を見せられ、その文字列を入力するように求められる。これは自動システムによるサイトへの嫌がらせを防ぐことを目的としている。歪んだ画像を読み込んで再処理するほどの進んだソフトが存在しない(少なくとも通常のユーザーには利用できない)ため、このような処理ができるシステムは人間だけである、ということがCAPTCHAの原理になっている。つまり裏を返せば、(おそらくだが)人工知能がいまだ完成されていないということになる。

専門家チューリングテスト

専門家チューリングテストと呼ばれるバージョンでは、機械の反応は特定の領域の専門家によって比較される。脳や体のスキャン技術が進歩すれば、人間のデータ要素をコンピュータシステムに複製することも可能になるかもしれない[48]。

不滅性テスト

不滅性テストと呼ばれるバリエーションは、人間の主要な個性が、オリジナルの人物と区別できないくらいそっくりに複製できたかを調べるチューリングテストである[49]。

最小知性シグナルテスト

最小知性シグナルテストは、クリス・マッケンストリー(Chris McKinstry)が提唱したチューリングテストのバリエーションである。YES/NOの返答のみが許可される。このテストは主に、人工知能プログラムと対照するための統計データを集めるために使われる。

Remove ads

脚注

参考文献

関連項目

外部リンク

Wikiwand - on

Seamless Wikipedia browsing. On steroids.

Remove ads