Podržano učenje

From Wikipedia, the free encyclopedia

Remove ads

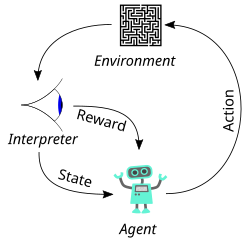

Podržano učenje (енгл. ) područje je mašinskog učenja i optimalne kontrole koje se bavi time kako bi inteligentni agenti trebali odabrati akcije u okruženju kako bi maksimizovali pojam kumulativne nagrade. Podržano učenje jedno je od tri osnovne paradigme mašinskog učenja, uz nadzirano učenje i nenadzirano učenje.

Podržano učenje se razlikuje od nadziranog učenja po tome što ne zahteva prikazivanje označenih ulazno/izlaznih parova, kao ni obavezno ispravljanje suboptimalnih akcija. Umesto toga, fokus je na pronalaženju ravnoteže između istraživanja (nepoznatih područja) i iskorištavanja (trenutnog znanja).[1] Okruženje se obično izražava u obliku Markovljevog procesa odlučivanja (MDP) jer mnogi algoritmi podržanog učenja u ovom kontekstu koriste tehnike dinamičkog programiranja.[2]

Glavna razlika između klasičnih metoda dinamičkog programiranja i algoritama podržanog učenja je da podržano učenje ne pretpostavlja poznavanje tačnog matematičkog modela MDP-a i da cilja na velike MDP-ove za koje tačne metode postaju nemoguće.[3]

Remove ads

Formalizacija problema

Zaleđina

Podržano učenje se uglavnom definiše kao Markovljev proces odlučivanja nazvan po ruskom matematičaru Markovu. Model je koncipiran kao skup stanja koja poseduju sve informacije o sistemu odnosno okolini koje modeluju. Svako od stanja omogućuje što preciznije predviđanje posledica svake izvedene radnje. MDP se formalno zapisuje kao četverac , pri čemu je:

- : množina svih mogućih stanja.

- : množina svih mogućih radnji u svakom stanju.

- : verovatnoća prelaza u stanje , pod pretpostavkom da se nalazimo u stanju i da je izvršena radnja .

- : nagrada / kazna

Strategija

Cilj postupka je pronaći strategiju ponašanja (policy) π: , koja za svako stanje [4]:61 i akciju maksimizira očekivanu buduću nagradu. Strategija se može menjati tokom učenja zavisno od količine dobijenih nagrada.

Postoji nekoliko opcija za odabir akcije, na primer:

- pohlepna: uvek će biti izabrana najbolja akcija -

- ε-pohlepna: uglavnom će biti izabrana najbolja akcija, povremeno sa verovatnoćom ε biće odabrana i nasumična akcija

Vrednost funkcije

Postoje dve slične varijante vrednosti funkcije

- Funkcije vrednosti stanja (state value function)

- Funkcije vrednosti prelaza između stanja (state-action value function)

Funkcije vrednosti definirane su kao alat za traženje maksimalne sume svih očekivanih nagrada pomoću sledećeg algoritma:

- Čekaj nagradu u budućnosti s faktorom umanjenja γ:

- Uvažavajući stanja :

- Uvažavajući prelaze između stanja :

Remove ads

Vidi još

- Podržano učenje na osnovu povratnih informacija od ljudi

Reference

Literatura

Spoljašnje veze

Wikiwand - on

Seamless Wikipedia browsing. On steroids.

Remove ads