热门问题

时间线

聊天

视角

基於人類回饋的強化學習

以回饋內容來訓練機器學習的技術 来自维基百科,自由的百科全书

Remove ads

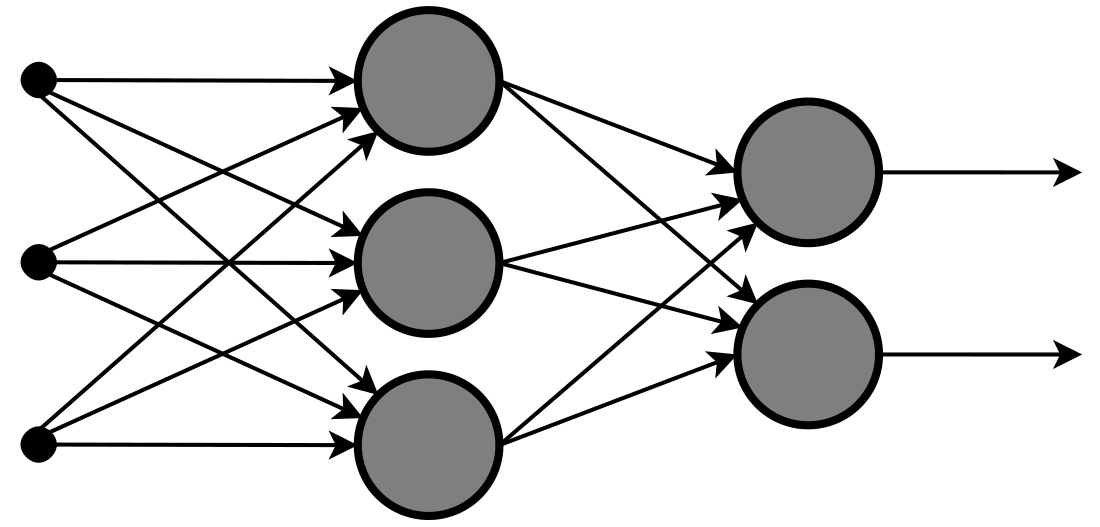

基於人類回饋的強化學習(英語:reinforcement learning from human feedback,簡稱RLHF),包括基於人類偏好的強化學習(reinforcement learning from human preferences),是一種直接根據人類回饋訓練「獎勵模型」的機器學習技術,並使用該模型作為強化學習中的獎勵函式,再通過近端策略最佳化等演算法以最佳化智慧型體(agent)策略。[1]獎勵模型在進行策略最佳化之前預先訓練,以預測給定的輸出是好(高獎勵)還是壞(低獎勵)。RLHF可以提高強化學習智慧型體的穩健性(robustness)和探索性(exploration),尤其適用於獎勵函式稀疏或有噪聲(不確定性)的情形。[2]

此條目可參照英語維基百科相應條目來擴充,此條目在對應語言版為高品質條目。 |

收集人類回饋

人類回饋最常見的收集方式是要求人類對智慧型體行為的實例進行偏好排序。[3][4][5]之後可以通過Elo等級分等方式利用排序結果對輸出進行評分。[1]雖然這種偏好判斷被廣泛採用,但還有其他類型的人類回饋可以提供更豐富的資訊,例如數字回饋、自然語言回饋和編輯率等。

訓練

標準RLHF假設人類偏好遵循成對比較的布拉德利-特里模型或者多重比較的普拉斯基特-盧斯模型(Plackett–Luce model),並通過最小化交叉熵損失以學習獎勵模型。[6]在訓練完獎勵模型之後,RLHF根據學習到的獎勵模型對語言模型進行進一步微調,使模型與人類偏好保持一致。

RLHF適用於模型輸出的品質難以用演算法清晰定義;但人類可以輕鬆判斷的任務。例如,如果模型的任務是生成一個引人入勝的故事,人類可以對人工智慧生成的不同故事的品質進行評分,而模型可以利用人類的回饋來提高其生成新故事的能力。

應用

RLHF已應用於自然語言處理的各個領域,例如對話、文字摘要和自然語言理解。在普通的強化學習中,智慧型體根據「獎勵函式」從自己的行為中學習。但在自然語言處理任務中,獎勵通常不容易定義或測量,特別是在處理涉及人類價值觀或偏好的複雜任務時尤其如此。在RLHF的幫助下,語言模型能夠提供與這些複雜價值觀相符的答案,生成更為詳細的回覆,同時拒絕不適當或超出模型知識空間的問題。[7]經RLHF訓練的語言模型包括OpenAI開發的ChatGPT及其前身InstructGPT[4]、Google DeepMind的Sparrow等。

除自然語言處理外,RLHF還被應用於電動遊戲機器人開發等其他領域。例如,OpenAI和DeepMind訓練的智慧型體能基於人類喜好來玩Atari遊戲。[8][9]這些智慧型體在多種測試環境中都表現出色,經常能超越人類的水準。[10]

參考文獻

Wikiwand - on

Seamless Wikipedia browsing. On steroids.

Remove ads